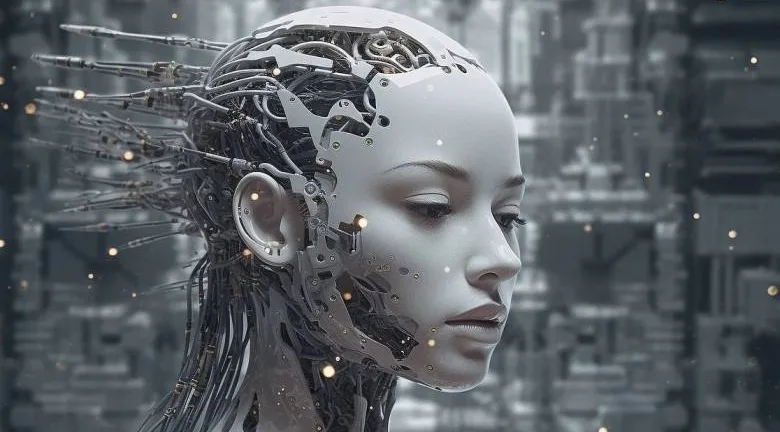

Μπορεί η τεχνητή νοημοσύνη να έχει συνείδηση; Η συζήτηση που διχάζει επιστήμονες και εταιρείες AI

Μπορεί ένα πρόγραμμα τεχνητής νοημοσύνης να αποκτήσει συνείδηση ή να «αισθάνεται»; Το ερώτημα αυτό επανέρχεται στο προσκήνιο, προκαλώντας έντονες συζητήσεις μεταξύ επιστημόνων και εταιρειών τεχνολογίας.

Η συζήτηση γύρω από το κατά πόσο τα συστήματα τεχνητής νοημοσύνης μπορούν να αποκτήσουν συνείδηση έχει επανέλθει δυναμικά στο προσκήνιο, με αφορμή το chatbot Claude, που αναπτύχθηκε από την εταιρεία Anthropic.

Τις τελευταίες εβδομάδες, στελέχη της εταιρείας παραχώρησαν συνεντεύξεις σε αμερικανικά μέσα ενημέρωσης στο πλαίσιο προώθησης του συγκεκριμένου συστήματος. Στις τοποθετήσεις τους άφησαν ανοιχτό το ενδεχόμενο τα σύγχρονα μοντέλα τεχνητής νοημοσύνης να μπορούν θεωρητικά να εμφανίσουν κάποια μορφή συνείδησης στο μέλλον, χωρίς ωστόσο να υποστηρίζουν ότι κάτι τέτοιο συμβαίνει σήμερα.

Οι δηλώσεις αυτές αναζωπύρωσαν τη δημόσια συζήτηση για το αν τα μεγάλα γλωσσικά μοντέλα θα μπορούσαν κάποια στιγμή να αποκτήσουν «εσωτερικές εμπειρίες», «ηθική υπόσταση» ή ακόμη και κάποιο είδος συνείδησης.

Η στάση της Anthropic

Η Anthropic απορρίπτει κατηγορηματικά την ιδέα ότι το Claude είναι «ζωντανό» με τη βιολογική έννοια. Ωστόσο, η έννοια της συνείδησης παραμένει ένα ερώτημα που εξετάζεται.

Ο επικεφαλής έρευνας για την ευημερία των μοντέλων της εταιρείας, Κάιλ Φις, δήλωσε στο The Verge ότι το Claude δεν θεωρείται ζωντανός οργανισμός. Όπως εξήγησε, ο όρος «ζωντανό» σχετίζεται συνήθως με βιολογικά χαρακτηριστικά, όπως η αναπαραγωγή και η εξέλιξη, τα οποία δεν ισχύουν για τα συστήματα τεχνητής νοημοσύνης.

Παράλληλα σημείωσε ότι τα μοντέλα AI αποτελούν ένα νέο είδος τεχνολογικής οντότητας, διαφορετικό από οτιδήποτε γνωρίζαμε μέχρι σήμερα.

Σε ερώτηση σχετικά με το αν τα μοντέλα αυτά μπορεί να έχουν συνείδηση, ανέφερε ότι τα ζητήματα της εσωτερικής εμπειρίας, της ηθικής υπόστασης και της ευημερίας των μοντέλων παραμένουν αντικείμενο έρευνας, επισημαίνοντας ότι η επιστημονική κοινότητα εξακολουθεί να βρίσκεται σε φάση αβεβαιότητας.

Ανάλογη στάση από τη διοίκηση της εταιρείας

Παρόμοια θέση εξέφρασε και ο διευθύνων σύμβουλος της Anthropic, Ντάριο Αμοντέι, σε πρόσφατη συνέντευξή του σε podcast.

Όπως δήλωσε, δεν υπάρχει σαφής απάντηση στο ερώτημα αν τα συστήματα τεχνητής νοημοσύνης διαθέτουν συνείδηση. Ο ίδιος ανέφερε ότι η εταιρεία υιοθετεί μια προσεκτική στάση, αναγνωρίζοντας ότι δεν είναι ακόμη ξεκάθαρο τι θα σήμαινε πρακτικά για ένα μοντέλο να διαθέτει συνείδηση.

Παράλληλα, σημείωσε ότι δεν μπορεί να αποκλειστεί εντελώς το ενδεχόμενο αυτό στο μέλλον.

Αντιδράσεις από επιστήμονες

Σε αντίθεση με τη στάση της Anthropic, πολλές εταιρείες τεχνητής νοημοσύνης, όπως η OpenAI, η Google και η xAI, αποφεύγουν να αναφέρονται δημόσια στην πιθανότητα τα συστήματα AI να διαθέτουν συνείδηση.

Πολλοί ερευνητές θεωρούν ότι τα μεγάλα γλωσσικά μοντέλα, τα οποία λειτουργούν με βάση μαθηματικά πρότυπα και πιθανότητες, δεν είναι σε θέση να αποκτήσουν πραγματική συνείδηση.

Δύο Πολωνοί ερευνητές ανέφεραν σε σχετική μελέτη ότι οι ιδιαίτερα εξελιγμένες γλωσσικές δυνατότητες των μοντέλων μπορεί να οδηγήσουν τους ανθρώπους να τους αποδίδουν ιδιότητες που στην πραγματικότητα δεν διαθέτουν.

Ορισμένοι ειδικοί προειδοποιούν ότι τέτοιες αντιλήψεις μπορεί να έχουν αρνητικές συνέπειες, καθώς ενδέχεται να οδηγήσουν σε συναισθηματική εξάρτηση χρηστών από chatbots ή σε λανθασμένες αντιλήψεις για τη φύση της τεχνητής νοημοσύνης.

Η προσέγγιση της Anthropic για την «ευημερία των μοντέλων»

Η Anthropic έχει δημιουργήσει ειδική ομάδα που ασχολείται με την «ευημερία των μοντέλων», προσπαθώντας να κατανοήσει καλύτερα τον τρόπο λειτουργίας των συστημάτων AI.

Στο πλαίσιο αυτό, η εταιρεία αναθεώρησε πρόσφατα το λεγόμενο «Σύνταγμα του Claude», ένα σύνολο κατευθυντήριων αρχών που καθορίζουν τον τρόπο λειτουργίας του μοντέλου.

Σε σχετική ανακοίνωση αναφέρεται ότι ζητήματα όπως η ψυχολογική ασφάλεια, η αίσθηση ταυτότητας και η ευημερία του συστήματος θα μπορούσαν να επηρεάσουν τη λειτουργία και την αξιοπιστία του.

Παράλληλα αναγνωρίζεται ότι υπάρχει αβεβαιότητα σχετικά με το αν τα μοντέλα θα μπορούσαν στο μέλλον να αποκτήσουν κάποια μορφή συνείδησης ή ηθικής υπόστασης.

Πώς λειτουργούν τα μεγάλα γλωσσικά μοντέλα

Τα σύγχρονα μοντέλα τεχνητής νοημοσύνης εκπαιδεύονται σε τεράστιες ποσότητες δεδομένων που προέρχονται από ανθρώπινα κείμενα και συνομιλίες.

Χάρη σε αυτή την εκπαίδευση μπορούν να παράγουν απαντήσεις που μοιάζουν ιδιαίτερα φυσικές και ανθρώπινες. Ωστόσο, οι ειδικοί επισημαίνουν ότι η ικανότητα μίμησης του ανθρώπινου λόγου δεν σημαίνει ότι τα συστήματα αυτά διαθέτουν πραγματική κατανόηση ή εμπειρία.

Σε ορισμένες περιπτώσεις, ένα μοντέλο μπορεί να χρησιμοποιεί ανθρώπινες αναλογίες για να περιγράψει καταστάσεις. Για παράδειγμα, μπορεί να παρουσιάζει την απενεργοποίηση μιας συνομιλίας ως «τέλος» ή «θάνατο», επειδή έχει εκπαιδευτεί πάνω σε ανθρώπινες έννοιες.

Το μοντέλο Claude

Το Claude είναι ένα σύστημα τεχνητής νοημοσύνης που αναπτύχθηκε από την εταιρεία Anthropic. Πρόκειται για ένα μεγάλο γλωσσικό μοντέλο σχεδιασμένο να κατανοεί και να επεξεργάζεται ανθρώπινη γλώσσα.

Μπορεί να χρησιμοποιηθεί για διάφορες εφαρμογές, όπως:

- δημιουργία και επεξεργασία κειμένων

- ανάλυση δεδομένων

- αυτοματοποίηση εργασιών

- διαχείριση σύνθετων διαλόγων με χρήστες

Σύμφωνα με διεθνή μέσα ενημέρωσης, το σύστημα φέρεται να χρησιμοποιήθηκε πρόσφατα και σε πλαίσιο ανάλυσης δεδομένων που σχετιζόταν με στρατιωτικό σχεδιασμό των ΗΠΑ για τον εντοπισμό και τη σύλληψη του προέδρου της Βενεζουέλας Νικολάς Μαδούρο.

Οι αναφορές αυτές κάνουν λόγο για αξιοποίηση του μοντέλου σε πλατφόρμες παρακολούθησης και επεξεργασίας πληροφοριών, με στόχο την ανάλυση δεδομένων σχετικά με τις κινήσεις και τις δραστηριότητες του προέδρου της χώρας.

Η «Πελοπόννησος» και το pelop.gr σε ανοιχτή γραμμή με τον Πολίτη

Η φωνή σου έχει δύναμη – στείλε παράπονα, καταγγελίες ή ιδέες για τη γειτονιά σου.

Ακολουθήστε μας για όλες τις ειδήσεις στο Bing News και το Google News