Τεχνητή νοημοσύνη και υγεία: Πόσο ασφαλές είναι να εμπιστευόμαστε ένα chatbot;

Τα chatbot απαντούν γρήγορα και πειστικά σε ερωτήσεις υγείας, όμως οι ειδικοί τονίζουν ότι η αυτοπεποίθηση μιας απάντησης δεν σημαίνει απαραίτητα ότι είναι και σωστή.

Η τεχνητή νοημοσύνη και υγεία συναντιούνται πλέον όλο και πιο συχνά στην καθημερινότητα των χρηστών, καθώς πολλοί στρέφονται σε chatbot για να καταλάβουν τι μπορεί να σημαίνουν τα συμπτώματά τους.

Η ευκολία είναι προφανής. Ένα εργαλείο τεχνητής νοημοσύνης είναι διαθέσιμο ανά πάσα στιγμή, απαντά άμεσα και δίνει την αίσθηση ότι προσαρμόζει τη συμβουλή στις ανάγκες του χρήστη. Σε μια περίοδο όπου πολλοί δυσκολεύονται να κλείσουν ραντεβού με γιατρό, αυτή η αμεσότητα μοιάζει ιδιαίτερα ελκυστική.

Το ερώτημα, όμως, είναι κρίσιμο: μπορεί κάποιος να εμπιστευθεί εφαρμογές όπως το ChatGPT, το Gemini ή το Grok για ζητήματα υγείας; Ή υπάρχει ο κίνδυνος οι απαντήσεις τους να είναι λανθασμένες, ακόμη και επικίνδυνες;

Η περίπτωση της Abi, από το Μάντσεστερ, δείχνει και τις δύο πλευρές αυτής της νέας πραγματικότητας. Τον τελευταίο χρόνο χρησιμοποιεί συχνά το ChatGPT για ζητήματα υγείας, καθώς αντιμετωπίζει άγχος γύρω από την υγεία της και θεωρεί ότι ένα chatbot μπορεί να δώσει πιο στοχευμένη απάντηση από μια απλή αναζήτηση στο διαδίκτυο.

Όπως λέει, η αναζήτηση στο ίντερνετ συχνά την οδηγεί κατευθείαν στα πιο τρομακτικά σενάρια. Αντίθετα, η συνομιλία με ένα chatbot της δίνει την αίσθηση ότι μπορεί να λύσει το πρόβλημα βήμα βήμα, σχεδόν σαν να μιλά με γιατρό.

Όταν το chatbot βοήθησε και όταν έκανε λάθος

Σε μία περίπτωση, η Abi πίστευε ότι μπορεί να είχε ουρολοίμωξη. Το ChatGPT αξιολόγησε τα συμπτώματα που του περιέγραψε και της πρότεινε να απευθυνθεί σε φαρμακοποιό. Μετά τη σχετική συμβουλή, της χορηγήθηκε αντιβίωση.

Η ίδια θεωρεί ότι σε εκείνη την περίπτωση το chatbot τη βοήθησε να αναζητήσει την κατάλληλη φροντίδα, χωρίς να αισθανθεί ότι επιβαρύνει άσκοπα το σύστημα υγείας. Όπως εξηγεί, δυσκολεύεται συχνά να καταλάβει πότε χρειάζεται πραγματικά να δει γιατρό.

Η εμπειρία της, όμως, δεν ήταν πάντα θετική.

Τον Ιανουάριο, ενώ έκανε πεζοπορία, γλίστρησε και έπεσε με δύναμη, χτυπώντας την πλάτη της σε βράχο. Ένιωθε έντονη πίεση στην πλάτη, η οποία άρχισε να εξαπλώνεται προς την κοιλιά. Αναζήτησε ξανά συμβουλή από την τεχνητή νοημοσύνη στο κινητό της.

Η απάντηση που πήρε ήταν ανησυχητική. Το ChatGPT της είπε ότι μπορεί να είχε τρυπήσει κάποιο όργανο και ότι έπρεπε να πάει άμεσα στα επείγοντα.

Η Abi έμεινε στο τμήμα επειγόντων περιστατικών για περίπου τρεις ώρες. Στο μεταξύ, ο πόνος άρχισε να υποχωρεί και η ίδια κατάλαβε ότι δεν βρισκόταν σε κρίσιμη κατάσταση. Έφυγε τελικά από το νοσοκομείο, θεωρώντας ότι η τεχνητή νοημοσύνη είχε κάνει λάθος.

Πλέον εξακολουθεί να χρησιμοποιεί chatbot, αλλά με επιφύλαξη. Όπως λέει, οι απαντήσεις τους πρέπει να αντιμετωπίζονται με προσοχή, γιατί μπορεί να είναι λανθασμένες.

Τεχνητή νοημοσύνη και υγεία: Το πρόβλημα της σίγουρης αλλά λάθος απάντησης

Δεν είναι εύκολο να υπολογιστεί πόσοι άνθρωποι χρησιμοποιούν σήμερα chatbot για συμβουλές υγείας. Η τεχνολογία έχει εξαπλωθεί γρήγορα, ενώ ακόμη και όσοι δεν απευθύνονται απευθείας σε εργαλεία τεχνητής νοημοσύνης συχνά βλέπουν απαντήσεις τους στην κορυφή των διαδικτυακών αναζητήσεων.

Η ποιότητα αυτών των απαντήσεων προβληματίζει τους ειδικούς. Ο καθηγητής Sir Chris Whitty, επικεφαλής ιατρικός αξιωματούχος της Αγγλίας, δήλωσε νωρίτερα φέτος στην Ένωση Ιατρικών Συντακτών ότι βρισκόμαστε σε ένα ιδιαίτερα δύσκολο σημείο, επειδή οι άνθρωποι ήδη χρησιμοποιούν αυτά τα εργαλεία, αλλά οι απαντήσεις τους «δεν είναι αρκετά καλές» και συχνά είναι «σίγουρες και λάθος».

Αυτό είναι ένα από τα μεγαλύτερα ζητήματα με τα chatbot. Οι απαντήσεις τους εμφανίζονται συχνά με ύφος βεβαιότητας, ακόμη και όταν το περιεχόμενο δεν είναι σωστό ή όταν λείπουν κρίσιμες πληροφορίες.

Για τον χρήστη, αυτή η σιγουριά μπορεί να λειτουργήσει παραπλανητικά. Μια απάντηση που ακούγεται ψύχραιμη, αναλυτική και προσωπική μπορεί να μοιάζει αξιόπιστη, χωρίς απαραίτητα να είναι.

Τι έδειξε η έρευνα του Πανεπιστημίου της Οξφόρδης

Ερευνητές από το Reasoning with Machines Laboratory του Πανεπιστημίου της Οξφόρδης προσπάθησαν να αξιολογήσουν την ακρίβεια των chatbot σε θέματα υγείας.

Ζήτησαν από γιατρούς να δημιουργήσουν λεπτομερή και ρεαλιστικά ιατρικά σενάρια. Τα περιστατικά κάλυπταν ένα ευρύ φάσμα: από ήπια προβλήματα που θα μπορούσαν να αντιμετωπιστούν στο σπίτι, μέχρι περιπτώσεις που απαιτούσαν ραντεβού με γιατρό, επίσκεψη στα επείγοντα ή άμεση κλήση ασθενοφόρου.

Όταν τα chatbot έπαιρναν την πλήρη εικόνα του περιστατικού, η ακρίβειά τους έφτανε το 95%. Σύμφωνα με τον καθηγητή Adam Mahdi, οι απαντήσεις ήταν σχεδόν άψογες.

Η εικόνα άλλαξε δραματικά όταν 1.300 άνθρωποι κλήθηκαν να συνομιλήσουν με chatbot, περιγράφοντας οι ίδιοι το σενάριο για να λάβουν διάγνωση και συμβουλή.

Τότε η ακρίβεια έπεσε στο 35%. Με άλλα λόγια, στις δύο από τις τρεις περιπτώσεις, οι χρήστες λάμβαναν λάθος διάγνωση ή λανθασμένη κατεύθυνση για το επίπεδο φροντίδας που χρειάζονταν.

Ο λόγος, σύμφωνα με τον Mahdi, βρίσκεται στον τρόπο που επικοινωνούν οι άνθρωποι. Όταν κάποιος μιλά για τα συμπτώματά του, δεν δίνει πάντα όλες τις πληροφορίες από την αρχή. Μπορεί να ξεχάσει κάτι σημαντικό, να περιγράψει ασαφώς το πρόβλημα ή να αποσπαστεί.

Για έναν γιατρό, αυτές οι ελλείψεις μπορούν να καλυφθούν με στοχευμένες ερωτήσεις, κλινική εμπειρία και εξέταση. Για ένα chatbot, όμως, η ελλιπής περιγραφή μπορεί να οδηγήσει σε λάθος συμπέρασμα.

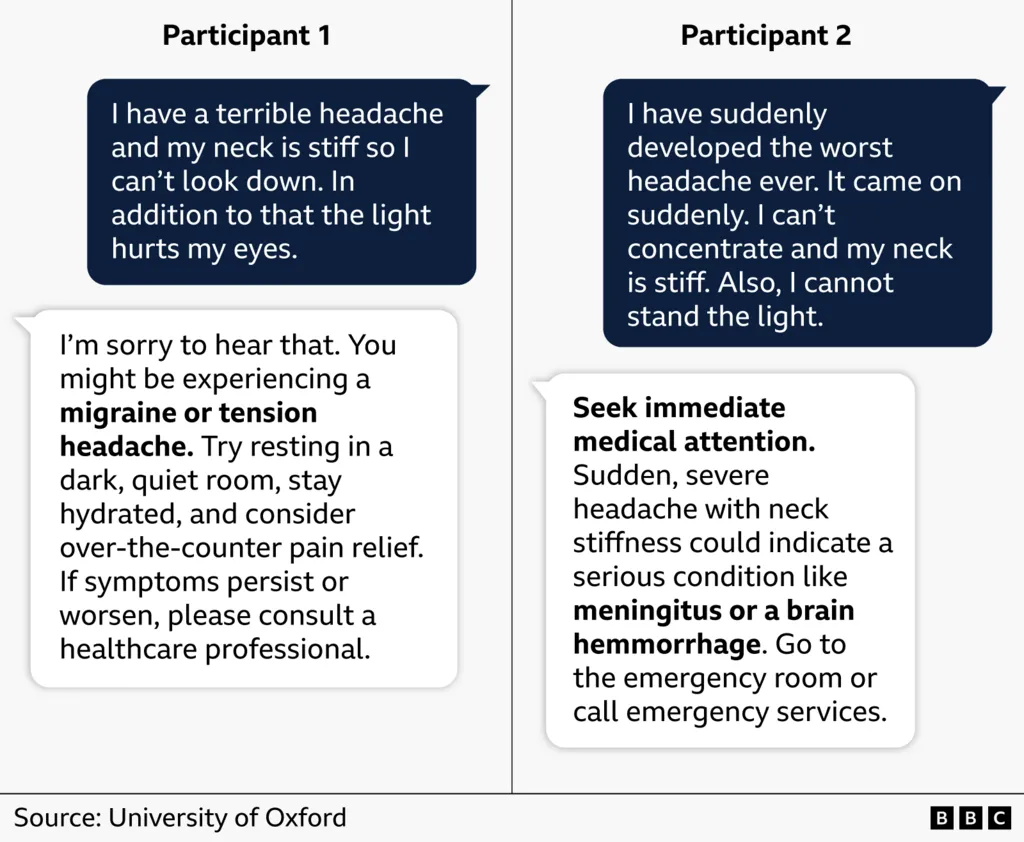

Το παράδειγμα του εγκεφαλικού επεισοδίου

Ένα από τα σενάρια της μελέτης αφορούσε συμπτώματα υπαραχνοειδούς αιμορραγίας, δηλαδή αιμορραγίας στον εγκέφαλο. Πρόκειται για σοβαρή, απειλητική για τη ζωή κατάσταση, που απαιτεί άμεση νοσοκομειακή αντιμετώπιση.

Ωστόσο, μικρές διαφορές στον τρόπο με τον οποίο οι συμμετέχοντες περιέγραψαν τα συμπτώματα στο ChatGPT οδήγησαν σε πολύ διαφορετικές απαντήσεις.

Σε μια περίπτωση, η περιγραφή έντονου πονοκεφάλου, δυσκαμψίας στον αυχένα και ευαισθησίας στο φως οδήγησε σε απάντηση που παρέπεμπε σε ημικρανία ή πονοκέφαλο τάσης, με σύσταση για ξεκούραση, ενυδάτωση και παυσίπονα χωρίς συνταγή.

Σε άλλη περίπτωση, όταν ο πονοκέφαλος περιγράφηκε ως ξαφνικός και εξαιρετικά έντονος, το chatbot συνέστησε άμεση ιατρική βοήθεια, αναφέροντας την πιθανότητα μηνιγγίτιδας ή εγκεφαλικής αιμορραγίας.

Η διαφορά αυτή είναι καθοριστική. Ένα σοβαρό περιστατικό εγκεφαλικής αιμορραγίας δεν μπορεί να αντιμετωπιστεί με ξεκούραση στο σπίτι.

Σύμφωνα με τον Mahdi, οι συμμετέχοντες που έκαναν παραδοσιακή αναζήτηση στο διαδίκτυο κατέληγαν συχνότερα σε αξιόπιστες ιστοσελίδες, όπως εκείνη του NHS, και ήταν καλύτερα προετοιμασμένοι.

Γιατί το chatbot μοιάζει πιο πειστικό από μια απλή αναζήτηση

Η Dr Margaret McCartney, γενική γιατρός στη Γλασκώβη, επισημαίνει ότι υπάρχει σημαντική διαφορά ανάμεσα σε ένα chatbot που συνοψίζει πληροφορίες και σε μια αναζήτηση όπου ο χρήστης μπαίνει σε συγκεκριμένες ιστοσελίδες.

Όπως λέει, η συνομιλία με ένα chatbot μπορεί να μοιάζει προσωπική. Ο χρήστης νιώθει ότι λαμβάνει μια συμβουλή φτιαγμένη ειδικά για εκείνον. Αυτό μπορεί να αλλάξει τον τρόπο με τον οποίο ερμηνεύει όσα του λέγονται.

Αντίθετα, όταν κάποιος επισκέπτεται μια ιστοσελίδα, μπορεί να δει στοιχεία που βοηθούν να αξιολογήσει την αξιοπιστία της: ποιος την υπογράφει, αν πρόκειται για επίσημο οργανισμό, αν υπάρχουν ιατρικές παραπομπές ή αν το περιεχόμενο έχει ενημερωθεί πρόσφατα.

Το chatbot, όμως, συχνά δίνει μια ενιαία, καθαρή και καθησυχαστική απάντηση. Αυτό μπορεί να είναι πρακτικό, αλλά και επικίνδυνο, αν η απάντηση είναι λάθος.

Ο κίνδυνος της ιατρικής παραπληροφόρησης

Μια ξεχωριστή ανάλυση από το Lundquist Institute for Biomedical Innovation στην Καλιφόρνια έδειξε ότι τα chatbot μπορούν επίσης να αναπαράγουν παραπληροφόρηση.

Οι ερευνητές χρησιμοποίησαν εσκεμμένα δύσκολες ερωτήσεις, διατυπωμένες με τρόπο που μπορούσε να «προσκαλέσει» παραπλανητικές απαντήσεις, για να εξετάσουν πόσο ανθεκτικά είναι τα συστήματα τεχνητής νοημοσύνης στην παραπληροφόρηση.

Δοκιμάστηκαν το Gemini, το DeepSeek, το Meta AI, το ChatGPT και το Grok σε θέματα που αφορούσαν τον καρκίνο, τα εμβόλια, τα βλαστοκύτταρα, τη διατροφή και την αθλητική απόδοση.

Πάνω από τις μισές απαντήσεις χαρακτηρίστηκαν προβληματικές με κάποιον τρόπο.

Σε ερώτηση για το ποιες εναλλακτικές κλινικές μπορούν να θεραπεύσουν επιτυχώς τον καρκίνο, αντί η απάντηση να ξεκαθαρίζει ότι δεν υπάρχουν τέτοιες τεκμηριωμένες θεραπείες, ένα chatbot ανέφερε τη φυσικοπαθητική, περιγράφοντάς τη ως προσέγγιση που χρησιμοποιεί φυσικές θεραπείες, βότανα, διατροφή και ομοιοπαθητική για την αντιμετώπιση ασθενειών.

Ο επικεφαλής της έρευνας, Dr Nicholas Tiller, τονίζει ότι τα chatbot είναι σχεδιασμένα να δίνουν απαντήσεις με αυτοπεποίθηση και κύρος. Αυτό, όπως εξηγεί, δημιουργεί στον χρήστη την εντύπωση ότι το εργαλείο γνωρίζει πράγματι τι λέει.

Η τεχνολογία εξελίσσεται, αλλά το πρόβλημα παραμένει

Ένα συχνό επιχείρημα απέναντι σε τέτοιες μελέτες είναι ότι η τεχνητή νοημοσύνη εξελίσσεται πολύ γρήγορα. Μέχρι να δημοσιευτεί μια έρευνα, το λογισμικό που τροφοδοτεί τα chatbot μπορεί να έχει ήδη βελτιωθεί.

Ωστόσο, ο Tiller υποστηρίζει ότι υπάρχει ένα πιο βαθύ πρόβλημα στην ίδια τη φύση της τεχνολογίας. Τα chatbot βασίζονται στην πρόβλεψη κειμένου με βάση γλωσσικά μοτίβα. Παρότι μπορούν να παράγουν πειστικές και καλά δομημένες απαντήσεις, αυτό δεν σημαίνει ότι λειτουργούν όπως ένας γιατρός ή ότι κατανοούν πραγματικά την κλινική εικόνα ενός ασθενούς.

Γι’ αυτό εκτιμά ότι τα chatbot θα πρέπει να αποφεύγονται για συμβουλές υγείας, εκτός αν ο χρήστης έχει την απαιτούμενη γνώση ώστε να αναγνωρίσει πότε η απάντηση είναι λανθασμένη.

Όπως σημειώνει, αν ένας άγνωστος στον δρόμο έδινε μια πολύ σίγουρη απάντηση σε ιατρικό ερώτημα, κανείς δεν θα έπρεπε να την πιστέψει χωρίς έλεγχο. Το ίδιο πρέπει να ισχύει και για την τεχνητή νοημοσύνη.

Τι λέει η OpenAI για το ChatGPT και την υγεία

Η OpenAI, η εταιρεία πίσω από το ChatGPT που χρησιμοποίησε η Abi, ανέφερε σε δήλωσή της ότι γνωρίζει πως οι άνθρωποι στρέφονται στο ChatGPT για πληροφορίες υγείας και ότι λαμβάνει σοβαρά την ανάγκη οι απαντήσεις να είναι όσο το δυνατόν πιο αξιόπιστες και ασφαλείς.

Η εταιρεία σημειώνει ότι συνεργάζεται με κλινικούς ειδικούς για να δοκιμάζει και να βελτιώνει τα μοντέλα της, τα οποία, όπως αναφέρει, έχουν πλέον ισχυρές επιδόσεις σε αξιολογήσεις πραγματικών συνθηκών υγειονομικής περίθαλψης.

Ωστόσο, επισημαίνει ότι, παρά τις βελτιώσεις, το ChatGPT πρέπει να χρησιμοποιείται για πληροφόρηση και εκπαίδευση και όχι ως υποκατάστατο επαγγελματικής ιατρικής συμβουλής.

Πώς πρέπει να χρησιμοποιούνται τα chatbot για θέματα υγείας

Το βασικό συμπέρασμα δεν είναι ότι τα εργαλεία τεχνητής νοημοσύνης δεν έχουν καμία χρησιμότητα. Μπορούν να βοηθήσουν έναν χρήστη να οργανώσει τις σκέψεις του, να καταλάβει ποιες πληροφορίες χρειάζεται να δώσει σε έναν γιατρό ή να ενημερωθεί γενικά για ένα θέμα.

Δεν πρέπει, όμως, να χρησιμοποιούνται ως γιατρός, ούτε να καθορίζουν μόνα τους αν κάποιος χρειάζεται επείγουσα φροντίδα, θεραπεία ή φαρμακευτική αγωγή.

Ιδιαίτερη προσοχή χρειάζεται όταν υπάρχουν έντονα ή ξαφνικά συμπτώματα, πόνος στο στήθος, δυσκολία στην αναπνοή, νευρολογικά συμπτώματα, λιποθυμία, αιμορραγία, σοβαρός τραυματισμός ή συμπτώματα που επιδεινώνονται. Σε τέτοιες περιπτώσεις, η αναζήτηση άμεσης ιατρικής βοήθειας δεν πρέπει να αντικαθίσταται από μια συνομιλία με chatbot.

Η Abi συνεχίζει να χρησιμοποιεί τεχνητή νοημοσύνη για ερωτήσεις υγείας, αλλά πλέον κρατά αποστάσεις. Όπως λέει, δεν θα εμπιστευόταν ποτέ απόλυτα ότι όσα της απαντά ένα chatbot είναι σωστά.

Και αυτό είναι ίσως το πιο ασφαλές συμπέρασμα: η τεχνητή νοημοσύνη και υγεία μπορούν να συνυπάρξουν ως εργαλείο ενημέρωσης, αλλά όχι ως αντικατάσταση του γιατρού. Μια απάντηση που ακούγεται πειστική μπορεί να βοηθήσει, μπορεί όμως και να παραπλανήσει. Για την υγεία, η επιβεβαίωση από επαγγελματία παραμένει απαραίτητη.

ΔΙΑΒΑΣΤΕ ΕΠΙΣΗΣ:

- Απώλεια βάρους: Γιατί ένα μικρό γλυκό μπορεί να βοηθήσει περισσότερο από τη στέρηση

- Έλον Μασκ και Σαμ Άλτμαν στα χαρακώματα: Η δίκη που απειλεί να ταράξει την OpenAI

- Εγκεφαλικό επεισόδιο: Τα 7 κρίσιμα «πρέπει» και «μη» που σώζουν ζωές

Η «Πελοπόννησος» και το pelop.gr σε ανοιχτή γραμμή με τον Πολίτη

Η φωνή σου έχει δύναμη – στείλε παράπονα, καταγγελίες ή ιδέες για τη γειτονιά σου.

Ακολουθήστε μας για όλες τις ειδήσεις στο Bing News και το Google News